Threads在向真正的”联邦宇宙“整合迈出重要一步

Meta CEO马克·扎克伯格宣布,现在你可以在Threads上关注联邦宇宙中的账号。Threads最初仅以非常有限的方式,让用户看到联邦宇宙用户的点赞和回复,但如今的情况也没有什么改变——联邦宇宙的帖子不会出现在你的信息流中,只有这些账户与Threads上的帖子互动后,你才能关注它们。

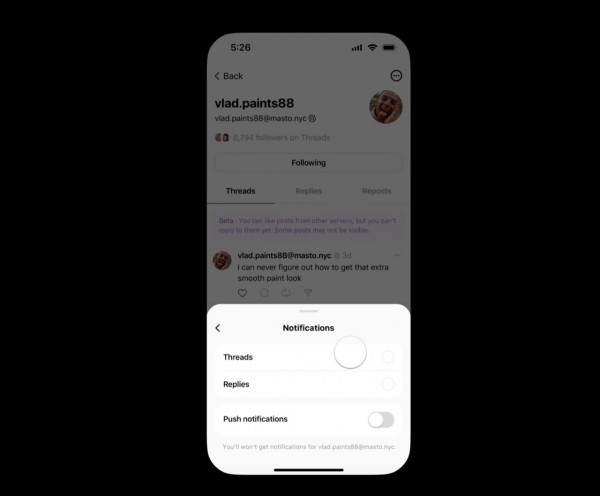

尽管联邦宇宙的帖子不会出现在信息流中,Instagram负责人亚当·莫塞里表示,它们的个人资料和帖子会出现在Threads上,并且你可以选择在它们发布内容时接收通知。至少这是一个进展,莫塞里发布了一个视频,展示了这一过程的具体操作:

扎克伯格表示,当你看到某个联邦宇宙账户“点赞、关注或回复”了某个联邦化的Threads个人资料时,你就可以关注该账户,但还有另一种方法可以找到这些账户。

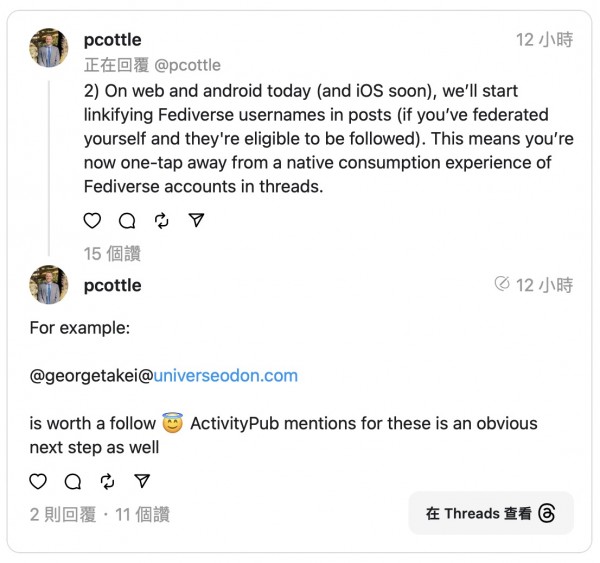

“在网页端和安卓端(iOS很快会推出),我们将开始将联邦宇宙的用户名链接化,”Threads开发者彼得·科特尔在一系列关于新整合的帖子中写道。科特尔补充道,你的账户需要是联邦化的,并且联邦宇宙账户必须“符合被关注的条件”。

科特尔还展示了如何标记联邦宇宙账户,链接到《星际迷航》演员及活动家乔治·武井的Mastodon账户:

Meta的赛恩·金在一封邮件中称,该平台的“目标仍然是负责任地推动联邦宇宙的发展,优先考虑建立一个安全、多样、内容丰富且具备互操作性的社区。”金还补充道,这一变化是Threads计划逐步实现与联邦宇宙完全互操作的又一步。

值得注意的是,最近几周,Threads的新功能加速了发布进程,或许这与Bluesky最近获得的关注有关。

来源:The Verge

好文章,需要你的鼓励

CIO对2026年AI发展的五大预测

2025年,企业技术高管面临巨大压力,需要帮助企业从持续的AI投入中获得回报。大多数高管取得了进展,完善了项目优先级排序方法。然而,CIO仍面临AI相关问题。支离破裂的AI监管环境和宏观经济阻力将继续推动技术高管保持谨慎态度。随着AI采用增长的影响不断显现,一些CIO预期明年将带来劳动力策略变化。

Anthropic最新CJE技术:让AI评判AI不再瞎猜,终结LLM评估乱象

这篇论文提出了CJE(因果法官评估)框架,解决了当前LLM评估中的三大致命问题:AI法官偏好倒置、置信区间失效和离线策略评估失败。通过AutoCal-R校准、SIMCal-W权重稳定和OUA不确定性推理,CJE仅用5%的专家标签就达到了99%的排名准确率,成本降低14倍,为AI评估提供了科学可靠的解决方案。

云成本管理变得更加便捷

FinOps基金会周四更新了其FinOps开放成本和使用规范云成本管理工具,新版本1.3更好地支持多供应商工作流。该版本新增了合同承诺和协商协议数据集,增加了跨工作负载成本分摊跟踪列,以及云支出和使用报告时效性和完整性的元数据可见性。随着云和AI采用推动企业IT预算增长,技术供应商正在关注将成本与价值联系起来的努力。大型企业通常使用三到四家云供应商,小企业可能使用两家,同时还有数据中心、SaaS和许可等服务。

NVIDIA团队让立体视觉AI实现“真正“实时运行:速度提升10倍却不牺牲精度

NVIDIA团队开发出Fast-FoundationStereo系统,成功解决了立体视觉AI在速度与精度之间的两难选择。通过分而治之的策略,该系统实现了超过10倍的速度提升同时保持高精度,包括知识蒸馏压缩特征提取、神经架构搜索优化成本过滤,以及结构化剪枝精简视差细化。此外,研究团队还构建了包含140万对真实图像的自动伪标注数据集,为立体视觉的实时应用开辟了新道路。

Reddit 发帖时将更不易违规

BuzzFeed 计划推出自有平台对抗 AI 驱动的社交媒体

TikTok 的美国禁令即将生效,用户抗议并寻找替代平台

开放社交网络项目Bridgy Fed成为非营利组织的一部分

Threads在向真正的”联邦宇宙“整合迈出重要一步

视觉能力媲美OpenAI,Meta发布Llama 3.2

Google发布Gemma 2 2B和Gemini 1.5 Pro,FLUX开源图像的新标杆,这就是这周的AI大新闻。

黄仁勋与扎克伯格做了一场关于Meta生成式AI未来的探讨(附对话实录)

NVIDIA和Meta正在“加速”一个开放、创新的AI世界

Llama 3.1:Meta迄今为止规模最大、质量最高的开源模型