TikTok禁令恐波及其他应用:CapCut、Lemon8等或难逃厄运

在美国,TikTok正一步步被迫走向封禁的边界,将此受此影响的,恐怕也不仅仅是TikTok。

正如Mashable上周末在报道中提到,众议院已经通过了该禁令的更新版本。一旦禁令的到总统签字认可,那么TikTok的在美经营将就此中止,除非字节跳动愿意让这个短视频平台被整体出售。

然而,受此类禁令影响的恐怕不只有TikTok用户。该法案也为美国未来对其他外国应用软件或平台的禁令铺平了道路。

上个月,Mashable分享了部分应用示例。一旦该法案落实为法律,这些应用程序同样可能受到影响,甚至可能波及微信,乃至Temu或AliEpxress等平台。虽然该法案的宽泛措辞确实将多家公司及其应用笼罩在打击范围之内,但目前唯一受到针对的就只有TikTok和字节跳动。

Axios还在报道中称,如果TikTok在美国被封禁,那么字节跳动旗下其他应用产品也将难逃厄运。

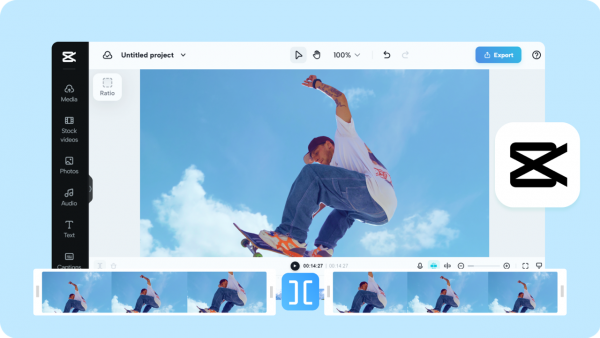

可能一同遭殃的还有CapCut、Lemon8、Lark等等?

虽然TikTok是字节跳动旗下最具知名度的应用程序,但该公司多年来在海外市场上投放了大量其他平台与软件,而且在其各自所处的目标市场中同样广受欢迎。

举例来说,CapCut(剪映海外版)已经成为移动设备和台式计算机上极具人气的视频编辑软件。TikTok及其他平台上的许多热门视频都是用CapCut创作而成。那些寻求快速、简单视频编辑功能的创作者,甚至开始使用CapCut处理长视频。然而CapCut归字节跳动所有,所以如果TikTok属于被打击的对象,那么CapCut亦断无存留的理由。字节跳动手中的照片编辑应用Hypic(醒图)也是同理。

Lark(飞书)是一套面向企业的生产力应用程序,包含文档、聊天、消息收发等功能。它基本上就是字节跳动版本的Google Workspace,该公司在内部业务中使用的就是这套工具。然而根据美国的TikTok禁令法案,Lark恐难逃被封禁的命运。

除了广受欢迎的社交视频平台之外,字节跳动还运营着与Pinterest或小红书类似的社交媒体平台,名为“Lemon8”。该平台在生活方式与健康社区中相当受欢迎。在字节跳动的整个应用生态当中,Lemon8的功能定位与TikTok最为接近,因此很可能会被一并拿下。

目前在美国市场运营的其他字节跳动应用,还包括其“AI学习伴侣”软件Gauth以及面向艺术家群体的音乐发行与版税平台SoundOn。这些都可能成为禁令之下被打击的对象。

如果TikTok禁令被通过,目前还不清楚后续事态将如何发展。但根据条文,字节跳动必须在今年之内基本剥离TikTok并整体出售。有报道指出,一旦法案通过,TikTok已经准备大打法律战以示抗议。因此哪怕字节跳动最终不得不选择将TikTok出售,恐怕也将是很久之后的事情了。

好文章,需要你的鼓励

三星Galaxy S26 Ultra最高优惠435美元,多款智能家居产品同步特惠

本轮优惠涵盖多款热门科技产品:Galaxy S26 Ultra捆绑Galaxy Buds 4 Pro可享325美元折扣,翻新开箱版最高优惠435美元;Galaxy Z Flip 7全新机型立减200美元,翻新版最低仅需701.99美元;谷歌最新款Nest门铃翻新版近百美元优惠;TCL TAB 10 Gen 4安卓平板降至150美元历史低位。三星旗舰产品翻新开箱版正成为当前最具性价比的选择。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

华为坤灵三年实践,智能化如何普惠中小企业?

谷歌向"AI优先"智能手机迈出关键一步

谷歌为Gboard引入Gemini语音听写功能,听写类初创企业面临压力

Android 17 九大重磅新功能抢先看

OpenAI成立独立咨询业务,加速企业AI落地部署

Oracle加快安全补丁发布节奏以应对AI网络安全威胁

Googlebook:专为安卓用户打造的理想笔记本电脑

HPE重构私有云产品栈,助力企业应对VMware迁移与AI需求

谷歌扩大Quick Share与AirDrop互通范围,新增QR码云端分享功能

Chrome for Android迎来完整Gemini集成与自动浏览功能

2026年Android Auto重大更新:视频应用、音乐升级与Gemini智能体验全面来袭

iOS 26.5更新苹果地图两项新功能详解