手机大模型的又一股势力?Hugging Face公布SmolLM模型

Hugging Face最近公布了一套新的紧凑型语言模型——SmolLM,这套模型在性能上超越了微软、Meta以及阿里巴巴千问系列的同类产品。这些新模型能够为个人设备提供先进的AI功能,且不会影响到设备端性能与用户隐私。

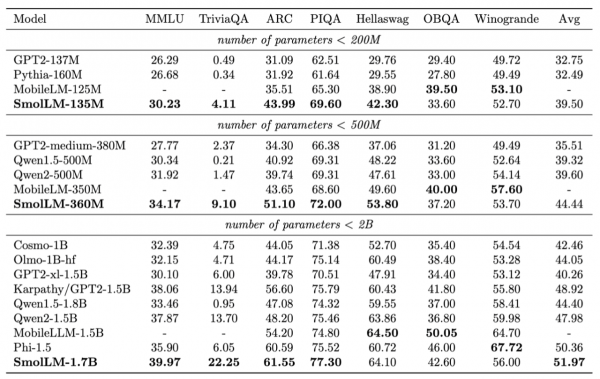

SmolLM家族拥有三位成员,参数规模分别为1.35亿、3.6亿及17亿,旨在适配不同水平的计算资源。尽管占用空间不大,但这些模型在常识推理与世界知识基准测试当中均拥有出色表现。

身小力不亏:SmolLM如何挑战AI行业巨头

Hugging Face公司SmolLM项目首席机器学习工程师Loubna Ben Allal强调,这些紧凑模型在针对特定场景时拥有相当出色的实践效果。她解释称:“我们不需要为每项任务分别建立大规模基础模型,正如我们没必要用拆除锤在墙上打眼儿。专为特定任务设计的小模型也能做好很多工作。”

其中体量最小的SmolLM-135M模型尽管在训练阶段使用的token更少,但表现仍然优于Meta的MobileLM-125M。SmolLM-360M号称在性能上超越了所有参数低于5亿的模型,包括Meta及阿里千问系列产品。旗舰级模型SmolLM-1.7B则在多项基准测试中击败了微软的Phi-1.5、Meta的MobileLM-1.5B以及千问Qwen2-1.5B。

Hugging Face还将包括数据管理到各训练步骤在内整个开发过程进行了开源,迅速获得业界关注。这种透明度也符合该公司对于开源价值主张以及支持可重复研究的承诺。

秘诀:高质量数据管理推动SmolLM获得成功

这些模型的出色表现,离不开精心策划的训练数据。SmolLM以Cosmo-Corpus为基础,其中包括Cosmopedia v2(合成教书与故事内容)、Python-Edu(教育性Python示例)以及FineWeb-Edu(精选的教育性网络内容)。

Ben Allal在采访时解释道:“通过SmolLM的现实性能,我们证明数据质量是决定模型水平的关键因素。我们开发出的创新方法能够精心策划高质量数据,将网络来源与合成数据相结合,从而建立起性能最佳小模型。”

SmolLM的发布也有望对AI的可及性及用户隐私产生重大影响。这些模型完全可以在手机及笔记本电脑等个人设备上运行,因此消除了云计算需求,同时缓解了成本与隐私问题。

推动AI大众化:SmolLM对可及性与隐私的影响

Ben Allal还专门强调了SmolLM家族的可及性优势:“这些能够在手机和个人电脑上运行、且性能出色的小模型,意味着每个人都可以使用AI技术。这些模型能够免费解锁新的可能性,具备完全隐私保障和更低的环境足迹。”

Hugging Face研究团队负责人Leandro von Werra在采访时还特别强调了SmolLM的实际意义。“这些紧凑型模型为开发人员和最终用户打开了一个充满可能性的世界。从个性化自动补全功能到解析复杂的用户请求,SmolLM无需昂贵的GPU或者云基础设施即可支撑起自定义AI应用程序。无论是降低AI的访问门槛、还是为每个人提供隐私保护,SmolLM的出现都代表着迈向未来的重要一步。”

像SmolLM这样强大、高效的小模型,也代表着AI技术迎来了重大转变。通过令高级AI功能更易于访问且符合隐私保护需求,Hugging Face解决了人们对于AI环境影响以及数据隐私等潜在威胁的日益增长的担忧。

随着SmolLM模型家族、数据集以及训练代码的正式亮相,全球AI社区及开发人员现在已经可以探索、改进并构建这种创新的语言模型方法。正如Ben Allal在采访中做出的总结:“希望更多人参与进来,帮助SmolLM更上一层楼!”

来源:VentureBeat

好文章,需要你的鼓励

马来西亚本土汽车品牌的电动化豪赌:靠爱国情怀能否赶比亚迪超特斯拉?

马来西亚,东南亚第二大汽车市场,长期以来被日韩汽车品牌占据主导地位。近年来,随着电动汽车的兴起,中国品牌比亚迪迅速崛起,占据了马来西亚电动汽车市场近 80% 的份额。面对这一局面,马来西亚政府将目光投向了本土汽车品牌 Proton 和 Perodua。

AutoGen Studio的开源界面:微软的AI应用开发平台AutoGen

微软推出了一个名为AutoGen Studio的开源界面。该界面可以通过设置Python API,以及简单的拖拽页面操作,从而无需编写代码,即可

详解英伟达Grace Hopper超级芯片架构

NVIDIA Grace Hopper 超级芯片架构将 NVIDIA Hopper GPU 的开创性性能与 NVIDIA Grace CPU 的多功能性结合在一起,在单个超级芯片

蚂蚁数科CEO赵闻飙首次解读新战略:布局“ABC”,加码技术出海

马来西亚本土汽车品牌的电动化豪赌:靠爱国情怀能否赶比亚迪超特斯拉?

简而不凡 | 新华三SMB系列新品重磅发布

落地AI的“最后一公里”:寻找企业应用的关键“钉子”

全球智慧 · 全链驱动 | 维谛技术 Vertiv 360AI智算研讨会勾勒AI基础设施全景图

AutoGen Studio的开源界面:微软的AI应用开发平台AutoGen

详解英伟达Grace Hopper超级芯片架构

她决定开源AI模型,正面宣战“N号房2.0”。

AutoGen:赋能大模型,解锁无限可能

悟空这一棒,打开了数字世界的立体交互新时代

Veeam通过不变性增强Microsoft 365备份

三个重大改变,让iPhone 16发布显得更加特别

落地AI的“最后一公里”:寻找企业应用的关键“钉子”

全球智慧 · 全链驱动 | 维谛技术 Vertiv 360AI智算研讨会勾勒AI基础设施全景图

AutoGen Studio的开源界面:微软的AI应用开发平台AutoGen

三个重大改变,让iPhone 16发布显得更加特别

支付宝发布AI生活管家App“支小宝”

凯文·凯利、王坚、沈向洋思辨2024外滩大会:人工智能还有哪些难题,如何追寻答案?

Google把Gemini聊天机器人塞进了Chrome的地址栏

推动AI无处不在,英特尔做了什么?

聊聊英伟达对SuperPOD AI的存储性能评估方法

IBM发布基于watsonx.data和Storage Scale的加速AI平台