经常用AI做视频?YouTube要求创作者主动标记

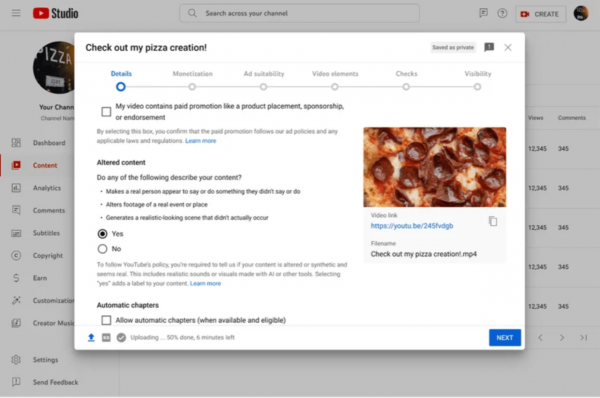

YouTube本周宣布,后续创作者需要向观众明确标注使用AI技术制作的视频内容。该平台在Creator Studio中引入了新工具,强调在可能被观众们误以为是真实人物、地点或事件的编辑/合成内容(包括由生成式AI输出的内容)处,创作者必须做出明确标记。

这项新规旨在防止用户受到蒙蔽,即误认为合成视频为真实素材,这是因为新的生成式AI工具已经让视频内容的真伪区别愈发困难。值此发布之际,专家们也再次警告称,AI与deepfakes深度伪造很可能在即将到来的美国总统大选期间掀起又一波误导风险。

此次发布的新规,也是YouTube继去年11月公布的大规模AI应用政策的延续与最新条款。

YouTube方面表示,新规并不要求创作者标记那些明显不太真实或者动画形式的内容,例如有人骑着独角兽穿越奇幻世界。新规也不要求创作者标明使用生成式AI进行辅助制作的内容,例如生成剧本或者自动字幕。

相反,YouTube的目标是帮助观众正确区分包含真实人物肖像的视频。例如,YouTube强调创作者必须披露自己在哪些部分对内容进行过数字编辑,包括“用其他人的面孔对当前人物进行换脸,或者用特定人物的合成音色为视频添加旁白。”

创作者还必须标明对真实事件或地点进行过编辑的镜头内容,例如用AI工具为一座真实建筑添加燃烧效果。同样受到限制的还有在真实场景下表现的重大虚构事件,例如龙卷风向真实存在的某处城镇移动。

YouTube表示,大多数视频只需要在扩展描述中添加“AI生成”标签。但对于涉及健康或新闻等较为敏感的主题视频,该公司要求创作者在视频画面处添加更显眼的标记提示。

未来几周内,观众将陆续在所有YouTube视频中看到这些标签信息。新规将首先登陆YouTube移动版应用,随后很快覆盖桌面及电视端视频。

YouTube还计划对坚持不添加标签的创作者采取强制措施。该公司表示,对于创作者没有自主添加标签的某些特定情况,YouTube会主动为其添加标签,特别是那些有可能混淆视听或误导人们认知的内容。

好文章,需要你的鼓励

思科 Cloud Control 究竟是什么?为何值得客户关注

思科在Cisco Live大会上推出Cloud Control,这是一个跨网络、安全、计算、可观测性与协作的统一管理平台。它提供单一登录、统一视图和共同操作模型,整合Meraki、Splunk、Intersight等产品。平台内置AI Canvas多人协作工作区,支持人机协同排障;Marketplace已接入AWS、微软、ServiceNow等50余家生态伙伴。思科将其定位为AI时代的核心运营层,致力于将庞大产品组合真正转化为统一平台。

中科大与上海创新研究院联手揭开AI学习秘密:训练大模型,“什么时候学“和“学什么“同样重要

这项由中科大、上海创新研究院等机构联合发表于arXiv 2026年的研究(编号2605.25381),提出在大模型强化学习训练中引入时间调度维度,通过动态演变信用分配标准,使模型推理能力更稳定、更可靠。

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

今天讲的出海案例是明阳电气,这家输配电设备公司在马来西亚投产首个海外生产基地,并以 250 万林吉特子公司承接本地制造。

当AI也能画出科研论文里的配图——伊利诺伊大学、清华与北大联合研发的智能科研绘图系统

CRAFTER是伊利诺伊大学香槟分校、清华大学与北京大学联合提出的多智能体科研配图生成框架,通过调度、迭代修正与结构化记忆,解决AI生成科研图示时的局部错误与不可编辑问题。

软件质量治理:企业数字化的隐性入场券

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

我用谷歌云盘新AI整理工具清理14年的文件杂乱,结果如何?

利用智能手机前置摄像头被动监测心率的研究系统

AI时代如何避免网络管理工具的重叠与混乱

英特尔凭借机器人芯片重磅杀入物理AI赛道

PATH计划:推动AI培训与职业发展,助力行业人才培育

AMD第二代Versal Prime加速器正式出货

微软为Windows引入Coreutils,让Linux开发者告别平台切换烦恼

Canva推出Perplexity Computer连接器,助力智能体自动生成设计资产

三星Health应用迎来重大AI改版,为Galaxy Watch 9铺路

Sonos Play 评测:便携智能音箱新标杆

最热门的 AI 模型:它们的功能和使用方法

这款古怪的 AI 智能手机可以创建你的数字分身

Faireez 获 750 万美元融资,为租赁市场提供 AI 驱动的酒店式管家服务

Broadcom 大获全胜:70% 大型 VMware 客户购买其最全面解决方案

Peer 获得1050万美元元宇宙引擎投资,推出3D个人星球功能

获 3000 万美元融资,Crogl 发布面向安全分析师的全新 AI "钢铁侠战衣"

Turing 获得 1.11 亿美元融资,估值达到 22 亿美元,为 OpenAI 等大语言模型公司提供关键代码支持

Tavus 推出系列 AI 模型,实现实时人脸交互技术突破

Welevel 获得 570 万美元融资,革新程序化游戏开发

AI 驱动的卓越运营:企业如何通过人人可及的流程智能提升成功