Chrome 的「@」快捷方式升级:直接在地址栏搜索书签和历史记录

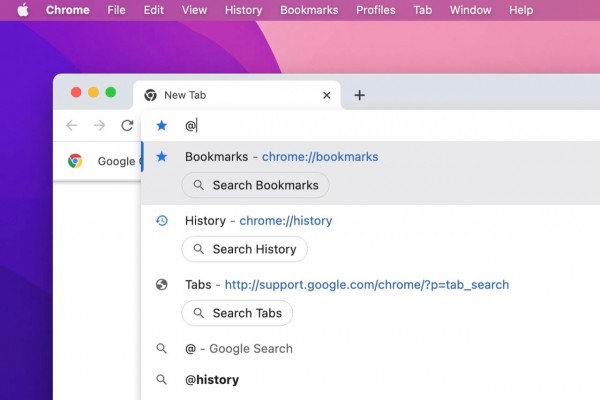

Chrome选项卡大师和书签囤积爱好者们,你们有福了!现在,大家可以通过地址栏中的「@」快捷方式快速搜索整个浏览器。在最新的桌面版Chrome 108上,这项功能将帮助大家简化操作,无需额外搜索网络即可直接进入之前曾经打开的选项卡。

相信很多朋友都会把大量重要的网址保存成书签。但随着书签数量的增加,实际管理和检索体验越来越麻烦,最后反而还是得靠搜索引擎重新寻找相应链接。如今,我们可以直接键入「@bookmarks」或键入「@」之后按空格键并单击「搜索书签」,即可通过关键词找到自己需要的书签内容。

同样的操作也适用于选项卡和历史记录。也许大家也曾经在十来个Chrome窗口里同时打开过几十个选项卡。要想再次将它们找出,只需输入「@」并按下空格键,之后单击「搜索选项卡」或「搜索历史」再输入关键字,就能很快找到当初的重要页面。

在旗下的服务中,Google从不掩饰自己对于「@」符号的喜爱。今年10月,Google刚刚为YouTube用户推出Twitter风格的全新「@」标头,还在Workspace/Google Docs产品中推出强大的全新开发者功能,可利用「@」标签调用外部文件和第三方应用程序。

这项新功能初步登陆于今年9月的ChromeOS 106测试版,之后逐步成为面向全体用户的正式功能。Google在博文中还提到一项现有Chrome功能,可供用户创建自己的自定义站点搜索快捷方式:

您是否有经常搜索的常用网站,例如YouTube或Google Drive?您可以激活自己的自定义站点搜索快捷方式,直接通过桌面版Chrome地址栏进行搜索。前往桌面版Chrome设置中的「管理搜索引擎和站点搜索」(chrome://settings/searchEngines)并激活。您也可以输入「customize site search」(自定义站点搜索)以直达该设置位置。

好文章,需要你的鼓励

不用再训练AI模型,香港科技大学团队发明“智能管家“,让AI一眼就知道该抓哪里用哪里

香港科技大学团队开发出A4-Agent智能系统,无需训练即可让AI理解物品的可操作性。该系统通过"想象-思考-定位"三步法模仿人类认知过程,在多个测试中超越了需要专门训练的传统方法。这项技术为智能机器人发展提供了新思路,使其能够像人类一样举一反三地处理未见过的新物品和任务。

YouTube推出基于Gemini 3的创作者游戏制作工具

YouTube Gaming宣布推出Playables Builder开放测试版,允许特定创作者使用基于Gemini 3的原型网页应用制作小型游戏,无需编程知识。该工具类似于Google Labs的Disco和GenTabs项目,通过自然语言输入生成交互式内容。尽管AI助手能帮助用户无需技术知识即可创作,但优秀游戏需要技巧、迭代和专业知识才能打造真正有趣的体验。

韩国KAIST让SVG动画脱胎换骨:AI如何破解矢量图形的“语义迷宫“让静态图标活起来

韩国KAIST开发的Vector Prism系统通过多视角观察和统计推理,解决了AI无法理解SVG图形语义结构的难题。该系统能将用户的自然语言描述自动转换为精美的矢量动画,生成的动画文件比传统视频小54倍,在多项评估中超越顶级竞争对手,为数字创意产业带来重大突破。

苹果发现:只需一个注意力层,就能让AI图像生成既快又好

YouTube推出基于Gemini 3的创作者游戏制作工具

英伟达是唯一能负担免费提供AI模型的厂商

OpenAI发布新旗舰图像生成AI模型GPT Image 1.5

脑启发算法可大幅降低AI能耗

Mac办公桌升级必备配件指南:提升工作效率的最佳选择

PTC Windchill+ 助力 HOLON研发全球首批符合汽车行业标准的 L4 级电动汽车

航旅行业的AI“乘法效应”:迈向指数级进化

OpenAI推出GPT Image 1.5模型加速图像生成竞争

Zoom推出AI Companion 3.0智能体工作流程

ChatGPT成为互联网最受阻止的爬虫机器人

英伟达推出开源权重模型填补美国AI市场空白

谷歌运用Anthropic Claude大模型改进自家Gemini AI

谷歌:AI智能体、多模态AI、企业搜索将在2025年占据主导地位

1小时,用Windsurf,0代码基础完成flomo插件开发!全公开

天气预报大模型,谷歌DeepMind初见成效

将 Chrome 浏览器默认搜索引擎换成 GPTSearch

英特尔和谷歌云联手推出第四代至强处理器支持的机密计算实例

Google把Gemini聊天机器人塞进了Chrome的地址栏

热浪和AI给数据中心高效运营带来重重压力

Chromecast寿终正寝,Google TV Streamer取而代之

Google发布Gemma 2 2B和Gemini 1.5 Pro,FLUX开源图像的新标杆,这就是这周的AI大新闻。