Chromecast寿终正寝,Google TV Streamer取而代之

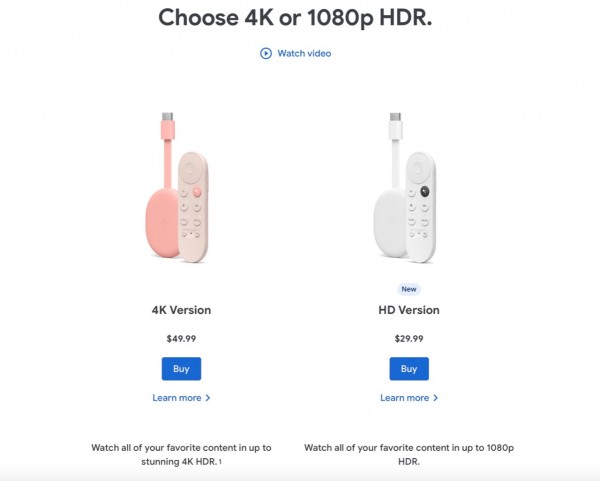

Google为电视机用户推出的流媒体产品目前只有一款Chromecast with Google TV,这款产品目前已经推出大约4年的时间,在2022年的一次更新,也仅仅是推出了一个更便宜、画质由4K降到HD的版本。

在Chromecast品牌目前为止11年的生命周期当中,这一系列设备的累计销量已经超过1亿台,市场表现相当不俗。不过,随着Google一系列新品即将推出,Chromecast产品线恐怕将要寿终正寝。

除了期待已久的Nest Learning Thermostat更新之外,Google本周发布了它最新一代的流媒体电视盒子,借此为下周的Made by Google 2024大会提前预热。

除了最直观的名称调整之外,该系列还迎来了更多额外的新功能,也代表着设计思路上的重大转变。Chromecast可通过HDMI线缆直接插入电视背面(类似Fire TV Stick电视棒),而Google TV Streamer尺寸更大,被设计为放置在电视下方的娱乐主机形式(类似小米盒子的概念)。

这款售价100美元的设备还兼具智能家居中心的功能,这也是Google为了重振Nest系列产品而做出的努力之一。

新功能允许用户更直接地控制Google Home并支持Matter配件。消费者基本可以将它视为连接电视大屏幕版的Nest Display或者Pixel Tablet平板。

丰富的附加功能必然需要搭配更大的无线传输频段,这反过来也让设备本身的尺寸愈发夸张。也正因为如此,最新一代Google TV Streamer根本无法像前任产品Chromecast那样以直插电视机背面的智能电视棒的形式存在。

除了支持Matter配件之外,新系统还配备内置的Thread边界路由器,能够改善与家用设备之间的连接。在UI当中添加Google Home面板则可以远程检查Nest摄像头(目前市面上还未出现第三方摄像头)并调节温度,同时控制其他能够支持Matter的智能家居设备上的功能。

与新款Thermostat恒温器一样,Gemini同样在Google TV Streamer当中扮演核心的驱动角色。但是与Pixel产品和其他Android设备不同,Home系列并没有从Assistant中被单独剥离出来。相反,这个最新版本将搭载专为它构建的本地模型。除了对话功能以外,Gemini还能够为用户挑选节目、规划观看体验。

Google公司在一篇文章中介绍称:“为了帮助用户轻松找到想要观看的内容,Google TV Streamer采用Google AI配合用户偏好数据为用户规划已订阅内容的收视建议,并将它们便捷、统一地组织起来。你甚至可以为家中每一位成员建立单独的推荐观看列表。”

Gemini大模型还将用于总结评价,甚至是概括影视剧集的各季情节;从这个角度来讲,这套模型发挥的作用其实跟它在过去一年来在Google搜索领域扮演的角色颇为相似。与Chromecast一样,Google TV Streamer系统同样支持4K播放。在这台体积稍大一些的装置内部,Google还为它升级了处理器,并将内存增加到32GB。

这款设备同样包含一个专用遥控器,面板上设有Netflix和Google Home的快捷键。此外,Google TV Streamer还提供一个内置按钮,当你找不到遥控器时,除了询问Google Assistant,也可以直接按下按钮。

Google TV Streamer已接受预订,而实际发货日期则要等到9月26日。

来源:TechCrunch

好文章,需要你的鼓励

诺奖得主辛顿:20年内超级智能会比我们更聪明,人类想生存只能成为被AI照顾的“婴儿”

2024年10月8日,Geoffrey Hinton(杰弗里·辛顿)因在人工神经网络领域的开创性工作获得诺贝尔物理学奖。

NVIDIA推出ChronoEdit:让AI图像编辑拥有物理常识的革命性技术

NVIDIA联合多伦多大学开发的ChronoEdit系统通过将图像编辑重新定义为视频生成问题,让AI具备了物理常识。该系统引入时间推理机制,能够想象编辑的完整变化过程,确保结果符合物理规律。在专业测试中,ChronoEdit超越了所有开源竞争对手,特别在需要物理一致性的场景中表现突出,为自动驾驶、机器人等领域的应用提供了重要技术突破。

AI推理新突破:乔治亚大学团队让大型语言模型学会“精打细算“的思考方式

这项研究提出了MITS框架,使用信息论中的点互信息指导AI推理过程,解决了传统树搜索方法计算成本高、评估标准模糊的问题。通过动态采样和加权投票机制,MITS在多个推理数据集上显著超越现有方法,同时保持高效的计算性能,为AI推理技术开辟了新方向。

亚马逊云科技的“AI毛坯房”,能解决游戏出海80%需求吗?

TE Connectivity 2025财年第四季度销售额增长17%,业绩高于预期销售额、经营利润率及现金流均创下全年新高

月之暗面AI模型注意力机制新突破:让AI更聪明更快的"记忆管理术"

Sora 2应用向美国等地用户全面开放,无需邀请码

Perplexity与Getty Images签署多年许可协议,应对版权争议

AWS业绩超华尔街预期,云基础设施需求持续旺盛

德州核电数据中心合作项目启动,计划2031年投产

高通骁龙X Elite和X Plus笔记本芯片详解

众智有为 致敬同路人|四川赛狄:从“碰撞”到“同路”,一位华为同路人的蜕变之旅

亚马逊股价大涨,AWS云业务增长加速

Microsoft 365 商业客户无处躲避 Copilot 功能扩张

Google Chrome推出AI操作按钮对抗AI浏览器