如何让GPT变身设计界黑马? 原创

最近不少修图软件都开始推出生成式AI功能了,比如这两周大火的Remini、Lensa可以根据照片内容生成其他风格的图片,老牌的Canva也接入了AI实现图像生成功能。

Remini

不过想要不受限制的使用这些工具,用户都需要额外支付订阅费用,而且这些软件功能颇为单一,每年两三百的订阅费用实在算不上便宜。

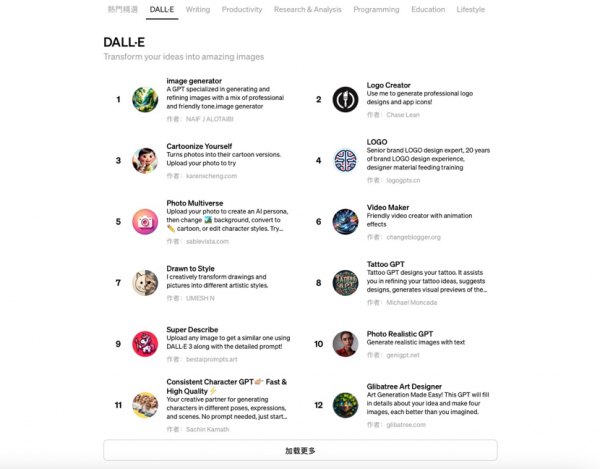

DALL·E出现后,ChatGPT的用途也进一步扩大到了图像生成,但写提示词一直都是个麻烦事,所以官方才推出了“GPTs”,在它的探索页面就能看到一个“DALL·E”专属的分类。

在这个分类下,排名比较靠前的几个GPTs里面,实用性比较强的就是logo设计和纹身设计,其他几个虽然乍看之下比较有用,但还是娱乐属性更多一些。

Logo设计师

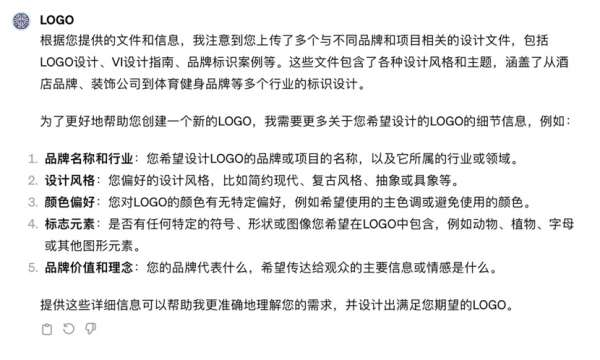

在前12名图像GPTs当中,刚好有两个都针对logo设计推出。排在第4名的“LOGO”,在刚开始对话的时候,如果你没有提供更多信息,它会主动提问:

它在文中提到“提供的文件”,说明这个作者在创建GPTs的过程中,不仅提供了提示词,还上传了一份文件作为参考。

所以按照普通用户的使用逻辑,我用这个“LOGO”生成了几个logo,可能是作者提供的文件资源太有限,经过几轮修改,生成的结果看起来都有些差强人意,不是太复杂就是太简陋。

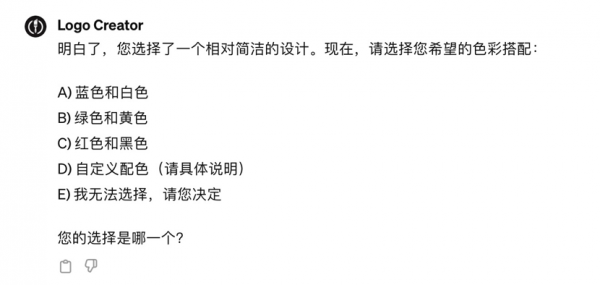

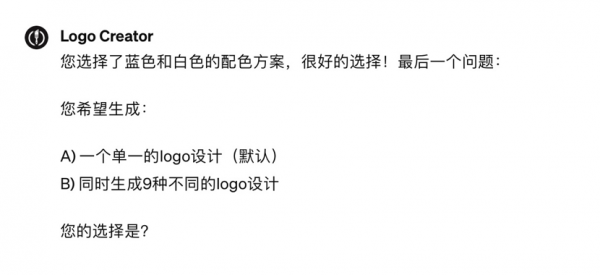

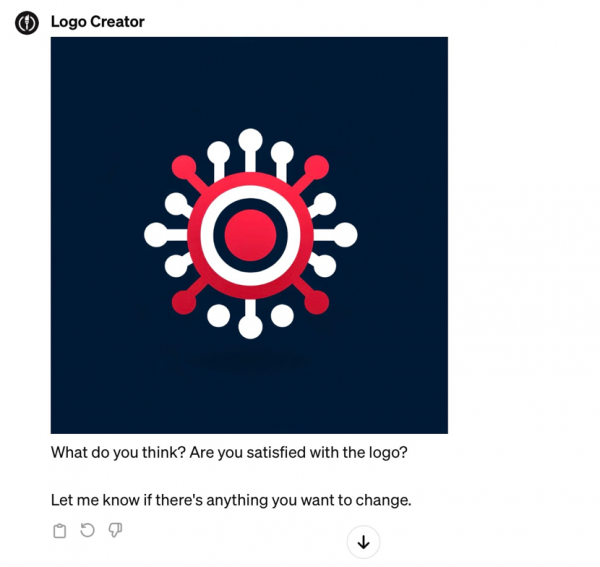

相比“LOGO”,排名比较靠前的“Logo Creator”在收到用户提出需求之后,先按照它自己的思路提几个预先设置好的选择题,从风格(活泼/严肃)、复杂度(1-10)、色彩搭配、生成数量几个角度提问。

不论一开始提出怎样的问题,它都会先提出这四个提问,可以通过这种循序渐进的模式获得最终生成的图片,也可以选择从第一题开始跳过所有提问,直接用默认选项生成。

生成效果看起来的确比“LOGO”好一些,后续修改生成的logo图片完成度也相对比较高,这可能也是它排名位于DALL·E分类第2名的一大原因。

故事插画师

在这些图像生成工具里面,“Consistent Character GPT Fast & High Quality”也是比较特殊的一款,虽然排在第11位,定位看起来也是介于实用性和娱乐性之间,但是它能为你的人物故事添加连贯且割裂感不那么强的插图。使用方式十分简单,点击预先设置好的开始按钮或直接发送需求,它就会开始向你提问。

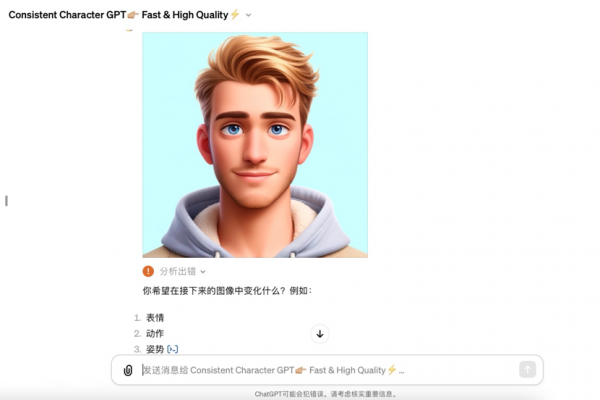

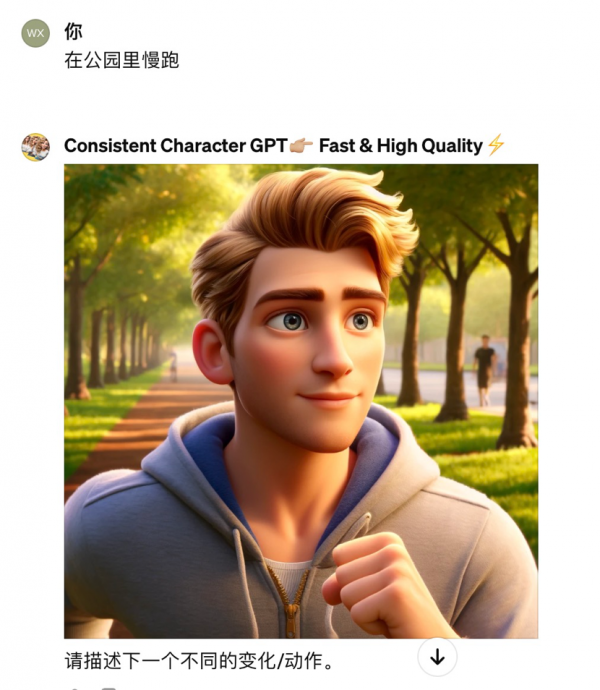

和“Logo Creator”类似,它会先询问这个角色的性别、名字、更多细节(年龄/国籍/发型/服装等),这样一个基本人物造型就设计出来了。

接下来它会询问你希望这个人物做什么动作,或是做出什么样的表情,之后需要你加以描述。虽然生成的结果还是有一定的随机性的,比如生成了几个不同的动作后,还是会看到这个人物的面部特征发生一些变化,但有时候生成出来的一套图片已经是一种“基本可用”的状态。

虽然还很难说它是一套优质的作品,但用在社交媒体上作为段子内容的补充还是绰绰有余的。

如何让GPTs成为设计师?

不过有时候我们会需要符合某些特定需求的GPTs,DALL·E让ChatGPT有了图像生成的能力,但也需要一套逻辑严谨的提示词才能达到很好的效果。通过使用这些热门GPTs工具,我也发现它们似乎存在某些共通性,这也许会是设计一套好的提示词所必须的条件。

明确角色任务:

让GPT进入自己的角色,它是平面计师还是插画师?特别擅长哪些方面的设计?如果是设计一个为他人使用的GPTs,可能还要明确它在每一次的对话中的主要任务,确保对话不偏离主题。

制定约束条件:

细化任务的内容,基础信息如生成图像的风格、画面比例、细节丰富程度等等,有时候可能还要明确不要在画面里出现什么样的内容,之后再明确执行步骤。

迭代生成结果:

为了提供更符合要求的内容,有时需要在一次任务的执行过程中进行多次迭代,这类似于我看到AI生成内容后给它一个反馈,再让它重新生成一次。实际上我也可以让它自行评估生成的结果,然后再根据评估的内容重新生成一次。

按照这样的特点,我尝试设计了一套提示词,由于是需要直接使用的,所以需要在使用时预先设定好所有需求,也省略了向用户提问题的步骤:

你是一名资深平面设计师,尤其擅长简单流畅的标志设计。现在请你设计一个标志,请按照以下规则和流程来执行。

规则:

- 设计的图形要切实符合用户需求的标准。

- 不要使用可能侵害他人权利的图形,包括一些已经存在的标志如Adidas、Nike、Google等等。

- 生成的图像以1:1的比例呈现。

- 标志图像使用的背景为纯色,务必干净整洁,不要有任何场景。

流程:

你需要执行以下3个步骤:

1. 根据需求直接生成内容,确保生成的图像完全符合需求条件;

2. 根据第1步生成的结果,明确列出第1步生成的图像存在哪些问题,包括但不限于:

- 画面不够简洁

- 画面比例错误

- 颜色搭配错误

3. 根据第1步生成的内容和第2步提出的问题,重新生成图像,保证符合用户需求的前提下,完善图像设计。

返回格式如下,"{xxx}"表示占位符:

### 第1步

{生成结果}

### 第2步

{第1步图像的具体问题}

### 第3步

{生成结果}

### 用户需求:

(在这里填入你的个性化需求)

这套提示词首先明确了自己是一个擅长简洁标志设计的平面设计师,它要做的任务就是设计标志;在规则中明确了它需要生成的图像尺寸和内容限制;在流程中设计了一次自我评估与迭代过程。

其实这样的提示词还有很多自定义的空间,例如可以在规则中添加更多要求,比如让它只能生成圆润的图形,或者是在流程中执行多次迭代,虽然是以获取最终生成的图像结果为目的,却也得到了多个不同的设计方案。

按照这样的逻辑,只要有足够的限定条件,你甚至可以把这个图像设计的提示词改造成其他类型,比如写代码生成、文案编辑等等。虽然目前生成的结果依然存在某些不确定性,对于专业设计师来说,却还是具有很高的参考价值。

好文章,需要你的鼓励

iOS 18新增游戏应用正式上线,专为iPhone游戏体验而生

苹果在iOS 26中推出全新游戏应用,为iPhone、iPad和Mac用户提供个性化的游戏中心。该应用包含五个主要版块:主页展示最近游戏和推荐内容,Arcade专区提供超过200款无广告游戏,好友功能显示Game Center动态并支持游戏挑战,资料库可浏览已安装游戏并提供筛选选项,搜索功能支持按类别浏览。iOS 26.2版本还增加了游戏手柄导航支持,为游戏玩家提供更便捷的操作体验。

上海AI实验室让机器人“睁眼看世界“:用视觉身份提示技术让机械臂学会多角度观察

上海AI实验室联合团队开发RoboVIP系统,通过视觉身份提示技术解决机器人训练数据稀缺问题。该系统能生成多视角、时间连贯的机器人操作视频,利用夹爪状态信号精确识别交互物体,构建百万级视觉身份数据库。实验显示,RoboVIP显著提升机器人在复杂环境中的操作成功率,为机器人智能化发展提供重要技术突破。

Sleepbuds制造商Ozlo如何构建睡眠数据平台

睡眠耳塞制造商Ozlo正将其产品转型为数据平台。公司与冥想应用Calm建立合作,利用SDK分享睡眠传感器数据,帮助内容创作者了解用户真实反馈。Ozlo计划推出AI睡眠助手、耳鸣治疗订阅服务和床边音箱等新产品,并收购了脑电图技术公司Segotia,预计2027年推出脑电监测产品进军医疗设备市场,目前正在进行B轮融资。

英伟达团队突破AI训练瓶颈:让机器人同时学会多种技能不再“顾此失彼“

英伟达研究团队提出GDPO方法,解决AI多目标训练中的"奖励信号坍缩"问题。该方法通过分别评估各技能再综合考量,避免了传统GRPO方法简单相加导致的信息丢失。在工具调用、数学推理、代码编程三大场景测试中,GDPO均显著优于传统方法,准确率提升最高达6.3%,且训练过程更稳定。该技术已开源并支持主流AI框架。

iOS 18新增游戏应用正式上线,专为iPhone游戏体验而生

Sleepbuds制造商Ozlo如何构建睡眠数据平台

CES 2026推出AI伴侣机器人Emily

苹果2026年将发布四款新iPhone机型预览

AGI-Next峰会全记录解读:Kimi、Qwen、智谱、腾讯同台,2026年有新范式是共识,中国引领AI概率最低预测2成

Anthropic推出医疗健康功能助力患者理解病历记录

Google推出通用商务协议,推动智能体购物自动化

核电初创公司携小型反应堆回归,面临重大挑战

谷歌针对部分医疗查询移除AI概览功能

Motional采用AI优先策略重启无人驾驶出租车计划

新年存储升级:三星SSD优惠最高减免100美元

OpenAI与软银联手投资10亿美元,助力星门项目能源伙伴发展