经常用AI做视频?YouTube要求创作者主动标记

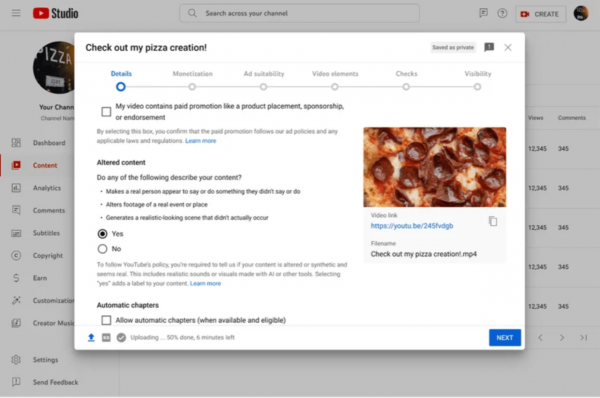

YouTube本周宣布,后续创作者需要向观众明确标注使用AI技术制作的视频内容。该平台在Creator Studio中引入了新工具,强调在可能被观众们误以为是真实人物、地点或事件的编辑/合成内容(包括由生成式AI输出的内容)处,创作者必须做出明确标记。

这项新规旨在防止用户受到蒙蔽,即误认为合成视频为真实素材,这是因为新的生成式AI工具已经让视频内容的真伪区别愈发困难。值此发布之际,专家们也再次警告称,AI与deepfakes深度伪造很可能在即将到来的美国总统大选期间掀起又一波误导风险。

此次发布的新规,也是YouTube继去年11月公布的大规模AI应用政策的延续与最新条款。

YouTube方面表示,新规并不要求创作者标记那些明显不太真实或者动画形式的内容,例如有人骑着独角兽穿越奇幻世界。新规也不要求创作者标明使用生成式AI进行辅助制作的内容,例如生成剧本或者自动字幕。

相反,YouTube的目标是帮助观众正确区分包含真实人物肖像的视频。例如,YouTube强调创作者必须披露自己在哪些部分对内容进行过数字编辑,包括“用其他人的面孔对当前人物进行换脸,或者用特定人物的合成音色为视频添加旁白。”

创作者还必须标明对真实事件或地点进行过编辑的镜头内容,例如用AI工具为一座真实建筑添加燃烧效果。同样受到限制的还有在真实场景下表现的重大虚构事件,例如龙卷风向真实存在的某处城镇移动。

YouTube表示,大多数视频只需要在扩展描述中添加“AI生成”标签。但对于涉及健康或新闻等较为敏感的主题视频,该公司要求创作者在视频画面处添加更显眼的标记提示。

未来几周内,观众将陆续在所有YouTube视频中看到这些标签信息。新规将首先登陆YouTube移动版应用,随后很快覆盖桌面及电视端视频。

YouTube还计划对坚持不添加标签的创作者采取强制措施。该公司表示,对于创作者没有自主添加标签的某些特定情况,YouTube会主动为其添加标签,特别是那些有可能混淆视听或误导人们认知的内容。

好文章,需要你的鼓励

让AI成为优秀倾听者而非试图做你最好朋友或心理健康顾问

本文探讨如何使用生成式AI和大语言模型作为倾听者,帮助用户表达内心想法。许多主流AI如ChatGPT、Claude等被设计成用户的"最佳伙伴",或试图提供心理健康建议,但有时用户只想要一个尊重的倾听者。文章提供了有效的提示词技巧,指导AI保持中性、尊重的态度,专注于倾听和理解,而非给出建议或判断。同时提醒用户注意隐私保护和AI的局限性。

北京大学团队首创WoW世界模型:让AI真正理解物理世界的革命性突破

北京大学团队开发出WoW世界模型,这是首个真正理解物理规律的AI系统。通过200万机器人互动数据训练,WoW不仅能生成逼真视频,更能理解重力、碰撞等物理定律。其创新的SOPHIA框架让AI具备自我纠错能力,在物理理解测试中达到80.16%准确率。该技术将推动智能机器人、视频制作等领域发展,为通用人工智能奠定重要基础。

通用人工智能和超级智能可能催生全新外星智能形态

人工通用智能和超级人工智能的出现,可能会创造出一种全新的外星智能形态。传统AI基于人类智能模式构建,但AGI和ASI一旦存在,可能会选择创造完全不同于人类认知方式的新型智能。这种外星人工智能既可能带来突破性进展,如找到癌症治愈方法,也可能存在未知风险。目前尚不确定这种新智能形态是否会超越人类智能,以及我们是否应该追求这一可能改变人类命运的技术突破。

港大和蚂蚁集团:AI如何让自己出题训练自己变聪明

香港大学和蚂蚁集团联合推出PromptCoT 2.0,这是一种让AI自动生成高质量训练题目的创新方法。通过"概念-思路-题目"的三步策略,AI能像老师备课一样先构思解题思路再出题,大幅提升了题目质量和训练效果。实验显示该方法在数学竞赛和编程任务上都取得了显著提升,为解决AI训练数据稀缺问题提供了新思路。

西部数据扩建系统集成测试实验室,以加速客户在持续增长的 AI 和云时代取得成功

深信服AI编程工具CoStrict首推严肃编程模式,为企业级开发而生

凝芯聚力筑根基,链动未来新机遇——IC China 2025携手全产业链领军企业邀您相约北京

让AI成为优秀倾听者而非试图做你最好朋友或心理健康顾问

通用人工智能和超级智能可能催生全新外星智能形态

人工智能研究新突破:英伟达、苹果、谷歌和斯坦福探索下一步发展

企业如何利用AI在金融领域获得竞争优势

2026年必须关注的五大机器人发展趋势

英伟达开始在台积电亚利桑那工厂批量生产Blackwell芯片

HPE与爱立信联合验证双模5G核心网技术

智能体AI来了,改变生活需要你的信任

谷歌Deepmind利用AI助力聚变反应堆技术突破

最热门的 AI 模型:它们的功能和使用方法

这款古怪的 AI 智能手机可以创建你的数字分身

Faireez 获 750 万美元融资,为租赁市场提供 AI 驱动的酒店式管家服务

Broadcom 大获全胜:70% 大型 VMware 客户购买其最全面解决方案

Peer 获得1050万美元元宇宙引擎投资,推出3D个人星球功能

获 3000 万美元融资,Crogl 发布面向安全分析师的全新 AI "钢铁侠战衣"

Turing 获得 1.11 亿美元融资,估值达到 22 亿美元,为 OpenAI 等大语言模型公司提供关键代码支持

Tavus 推出系列 AI 模型,实现实时人脸交互技术突破

Welevel 获得 570 万美元融资,革新程序化游戏开发

AI 驱动的卓越运营:企业如何通过人人可及的流程智能提升成功