有没有必要把Bard等AI功能整合到Google Assistant?

在接下来的几个月甚至几年中,谷歌肯定会不断把AI驱动功能引入其核心应用,从而带来颠覆性的使用体验。从目前这波初步整合的共性来看,我很好奇谷歌要怎么设计它们的品牌归属。谷歌那边当然有不少选项,但对AI功能来说,Google Assistant也许正是最好的归宿。

生成式AI与Google Assistant间的共性

生成式文本AI能查找信息,并以顺畅自然的方式展示信息内容。用户可以借此为相关但又有细微差别的问题各自寻找答案,并将结果整理成文本。从本质上讲,这项新技术将帮助我们完成以往大量需要手动操作的工作。

截至去年5月,谷歌给自家助手服务定下的发展目标,仍然是“为日常任务提供最简单的解决办法”。

而这种直接生成答案的能力,无疑是帮助助手达成目标的最佳要素。之前,来自谷歌知识图谱和精选片段的信息往往无法被直接转化成口语表达,所以没法被助手拿来服务用户。

有了Bard(或者应该叫“实验性对话AI服务”),Google Assistant肯定能走得更远、完成更复杂的任务——例如创建出游行程,帮助用户培养爱好或者提供购买建议。

在这类用例的熏陶下,Google Assistant肯定会变得愈发强大,逐步克服中断、暂停和自我纠错之类让人出戏的对话体验。

对话功能无疑是智能助手的自然扩展,而且在语音交互这类特定情景下意义尤其重大。

关于Google Assistant的一切

谷歌完全可以引入Bard或其他LaMDA成果衍生出的体验,显著改善Google Assistant的使用感受。当然,如果这些生成式AI功能入驻其他应用品牌,也同样有着不错的发展前景。

在I/O 2021大会首次公布LaMDA时,谷歌表示会将对话功能纳入助手、搜索和Workspace等服务。现在,搜索领域的AI入驻已经开始,公司CEO Pichai周三表示“正努力将大语言艺术形式引入Gmail和Docs。”

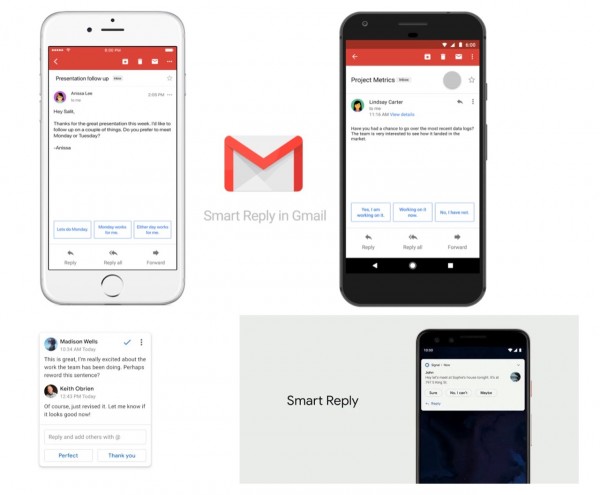

共享现有品牌名称是有出处的。Smart Reply“智能回复”就可以溯源至Gmail、Google Chat、Android甚至是Docs(注释)。当然,当时的Smart Reply和Compose在功能上还远达不到独立产品的水平。

总之,生成式AI在功能上确实已经比较完备,既能撰写电子邮件、也能回答指导性的问题。这一切,都跟人们希望在Google Assistant身上看到的效果高度一致。

过去一年来,谷歌一直专注于改善助手的语音功能,同时又在探索驾驶模式、快照和记忆等具体技术细节。其目的,是通过在Pixel手机和Nest Hub Max上通过Quick Phrases快速发令来消除“嗨,谷歌”这种生硬的激活需求,从而让Google Assistant的交互感更加自然。Smart Display甚至支持“眼神交流”,使个眼神就能发出命令。

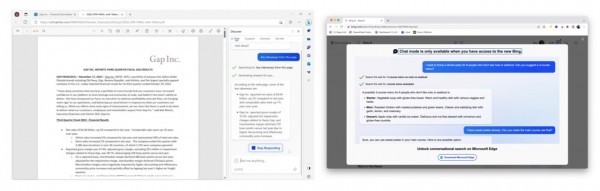

而在Chrome上直接添加AI功能按钮,跟Google Assistant的那种交互操作是明显相悖的,前者以网页为基础、必然更强调键盘输入的体验。但这样也还可以,至少比把它加到Google Chat上更有实际意义。

谷歌毕竟是谷歌

千言万语汇成一句话:谷歌的目标从未动摇,就是让自己成为用户全部知识的来源。助手服务号称是“您的个人谷歌”;而激活语也是“嗨,谷歌”,而不是“嗨,助手”。

从前景来看,微软的AI首秀就是新Bing,Bing的徽标也出现在了Edge浏览器的右侧。至于聊天机器人功能,微软将其命名为“聊天模式”。对我来说,跟搜索引擎直接对话其实有点怪。AI机器人会表现出某种个性,我实在不适应把一项纯工具性的功能搞得这么活泼。

当然,谷歌也可能不把这些生成式AI归入统一品牌,而是让其广泛渗透到各个应用程序的各个角落,包括Gmail或Docs。但这样冲击力就弱了,也不符合发展新业务的一般思路。

从Gmail到Calendar,再到Maps和Photos,谷歌其实一直喜欢给产品单独命名。虽然品牌形象不酷,但我们至少能明确做出区分。从这个角度看,已经掀起全球变革的辅助性AI必须拥有姓名!

好文章,需要你的鼓励

SAP 2026年蓝宝石大会:CEO承认AI战略曾走弯路,全面转向业务自主化【正常】

SAP首席执行官Christian Klein在2026年Sapphire大会上坦承,公司约在八九个月前调整了AI战略方向,从强调AI技术本身转向聚焦业务成果,目标是实现"自主企业"愿景。SAP发布了全新品牌SAP Business AI和SAP Autonomous Suite,重构AI平台以更好融入客户业务上下文。SAP高管还强调,需防范"智能体失控"风险,并引入"企业记忆"概念提升AI决策的精准度。

眼睛看得多,就一定懂得多吗?清华大学等机构揭开多源视觉推理的隐藏陷阱

研究揭示多源视觉融合并非总有益,提出MARS框架通过单源锚点量化信息增益,动态调节多源融合优势,在多个视觉推理任务上实现显著性能提升。

NHS单一患者电子档案或每年减少两万次急诊就诊并节省两千万英镑【正常】

英国卫生与社会保障部发布测算数据,显示NHS数字化单一患者记录(SPR)每年可减少约2万次急诊就诊,并节省约2000万英镑。该计划将强制要求全科医生和医院共享患者数据,形成统一的健康档案,患者可通过NHS App访问。该措施是政府100亿英镑医疗数字化计划的核心。此外,NHS虚拟医院NHS Online已正式成立,预计2027年上线,首三年可提供约850万次诊疗服务。

MiniMax推出超高效AI大模型:用10%的“算力油耗“,跑出顶级AI的实力

MiniMax发布M2系列混合专家大模型,总参数2299亿但每次仅激活98亿,通过专项数据流水线、Forge强化学习系统和自进化机制,在代理编程、深度搜索等任务上达到顶级闭源模型水平。

NHS单一患者电子档案或每年减少两万次急诊就诊并节省两千万英镑【正常】

苹果智能眼镜据报道推迟至2027年底发布

2026年第一季度Mac恶意软件威胁态势全面回顾【正常】

AI的冷漠与空洞:它的乏味之声为何契合当下政治氛围【正常】

苹果新版Apple TV与HomePod mini将于今秋发布,Siri遥控器或迎来更新

从被动响应到自主运营:IT领导者下一步该怎么做【正常】

苹果AI智能眼镜延迟至2027年底发布,Vision Air最早2029年亮相

真正改善日常生活的家居AI功能盘点

"心灵子嗣"会是人类繁殖的未来吗?

水资源成为AI数据中心扩张的新瓶颈【正常】

CoreWeave推出AI智能体自主优化能力,企业部署效率大幅提升

英国智库呼吁:赋予员工更多AI决策权,确保技术红利公平共享