AI创作工具Stable Diffusion与Midjourney遭遇版权诉讼

已经有三位艺术家对AI艺术创作工具Stable Diffusion及Midjourney的开发商Stability AI和Midjourney提起诉讼;一同被卷入官司的,还有近期刚刚建立自家AI艺术创作工具DreamUp的艺术创作平台DeviantArt。

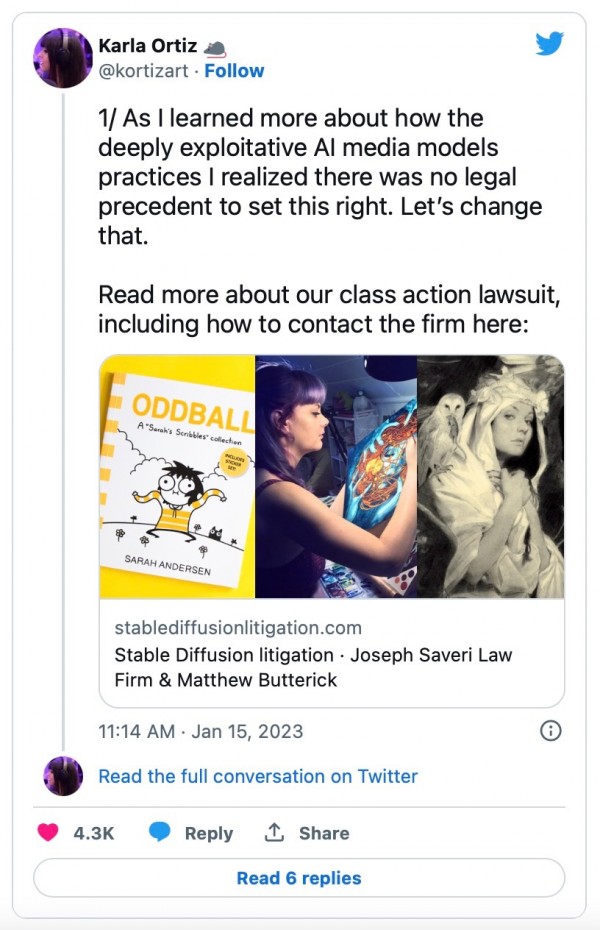

原告艺术家Sarah Andersen、Kelly McKernan和Karla Ortiz宣称,这些组织侵犯了“数百万艺术家”的权利。他们在“未经艺术家同意 ”的情况下,从网络上抓取50亿张由艺术家原创的图片来训练自己的AI工具。

该诉讼由律师兼字体设计师Matthew Butterick,以及专门从事反垄断及集体诉讼案件的Joseph Saveri律师事务所发起。Butterick和Saveri目前还在起诉微软、GitHub和OpenAI,矛头主要指向AI编程模型CoPilot,该模型所使用的代码训练素材同样收集自网络。

随着对剥削性AI媒体模型实践方式的深入理解,我意识到尚无法律先例用于保护这一权利。我们要改变这样的现实。

在宣布诉讼案的博文中,Butterick将此案描述为“推动AI遵循公平与道德原则的重要一步”。他解释道,像Stable Diffusion这样的AI艺术创作工具能够“用几乎无限数量的侵权图像训练自身,快速产出仿作并给市场、艺术品和艺术家造成永久性的损害。”

过去一年来,这些AI艺术创作工具确实大受欢迎,而艺术界对此反响强烈。有人认为这些工具确实很有用,跟之前几代革命性软件(例如Photoshop和Illustrators)差不多;但更多人反对把自己用以谋生的素材用于训练这些商业系统。生成式AI艺术创作模型依靠网络上收集的数十亿张图像进行训练,且整个过程通常未得到素材创作者的知情或同意。之后,AI艺术创作工具就能快速产出模仿特定艺术家风格的作品。

但这些系统到底有没有侵犯版权法,确实是个复杂的问题。专家表示这个问题恐怕得在法庭上讨论解决,而AI艺术创作工具的开发者们普遍认为,至少在美国,使用受版权保护的数据训练该软件完全符合《合理使用原则》中的要求。考虑到AI艺术创作工具中的种种复杂因素,即使是“合理使用”也需要接受诉讼的考验。包括这些工具背后的开发组织具体位于哪里(欧盟和美国对于数据抓取的法律许可有所区别),还要区分各机构的具体目的(例如,Stable Diffusion是在LAION数据集上训练而成,而该数据由德国人以非营利组织的名义收集,因此享受到了比普通企业更优惠的待遇)。

Butterick和Joseph Saveri律师事务所发起的诉讼,曾因涉及技术错误而受到抨击。例如,诉讼宣称AI艺术创作模型“存储[受版权保护的]训练图像的压缩副本”并加以“重组”,其作用类似于“21世纪的拼贴工具”。但AI艺术创作模型根本不存储图像,而只保存从这些图像中收集到的模式的数学表示。该软件也不是在以拼贴画的形式构建图像,而是根据数学表示从零开始自行创作。

好文章,需要你的鼓励

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

今天讲的出海案例是明阳电气,这家输配电设备公司在马来西亚投产首个海外生产基地,并以 250 万林吉特子公司承接本地制造。

当AI搜索员越读越多,反而越读越蒙:UC San Diego等机构揭示“屏蔽旧信息“的隐藏规律

研究揭示AI搜索代理"屏蔽旧观测"策略的效果取决于检索质量与模型能力的匹配程度,存在三种截然不同的效果区间。

DNS-AID:Linux基金会推出让AI智能体更易发现的新标准

随着AI智能体数量持续增长,如何高效定位和发现它们变得至关重要。Linux基金会发起DNS-AID项目,旨在通过扩展现有DNS基础设施,为AI智能体提供一种无需新建设施的发现、验证与通信标准。该项目支持智能体及MCP服务器将DNS用作全局、供应商中立的目录,域名所有者可通过创建特定地址作为智能体查找入口。该项目最初由Infoblox开发,已获德国电信和亚马逊等机构参与贡献。

机器人“听懂“指令却不知道该抓哪个——哈工大等机构联合揭示VLA模型的致命短板

多所高校与研究机构联合构建机器人语义接地测试平台RSB,发现主流VLA模型普遍存在"能抓但抓错"的致命缺陷,语义理解与动作生成之间存在严重断层。

明阳电气马来西亚首个海外生产基地投产,输配电设备开始本地制造

亚马逊关闭开发者"刷Token"排行榜以控制成本

Meta考虑进军超大规模云服务市场

无人机地图新功能助力英国飞手避免空域冲突

大疆无人机助力揭开危地马拉隐藏的玛雅古城群

Waymo退役机器人出租车电池将重返能源领域发挥余热

认识Dalton:一款全新的AI驱动药物研发平台【AI】

Cisco发布Cloud Control平台:以网络为核心驱动AI基础设施新时代

英国房产数字身份证计划因政策不明宣告搁浅

欧盟发布全栈主权计划,全力构建欧洲科技实力

AI提效百倍,生产力革命为何迟迟未至?SAP自主运营企业瞄准企业“弱链”

数学家发出警告:AI正威胁数学研究的自主性与学术标准

最热门的 AI 模型:它们的功能和使用方法

这款古怪的 AI 智能手机可以创建你的数字分身

Faireez 获 750 万美元融资,为租赁市场提供 AI 驱动的酒店式管家服务

Broadcom 大获全胜:70% 大型 VMware 客户购买其最全面解决方案

Peer 获得1050万美元元宇宙引擎投资,推出3D个人星球功能

获 3000 万美元融资,Crogl 发布面向安全分析师的全新 AI "钢铁侠战衣"

Turing 获得 1.11 亿美元融资,估值达到 22 亿美元,为 OpenAI 等大语言模型公司提供关键代码支持

Tavus 推出系列 AI 模型,实现实时人脸交互技术突破

Welevel 获得 570 万美元融资,革新程序化游戏开发

AI 驱动的卓越运营:企业如何通过人人可及的流程智能提升成功