英特尔公布Loihi神经形态芯片 仅根据气味识别多种有害化学物质

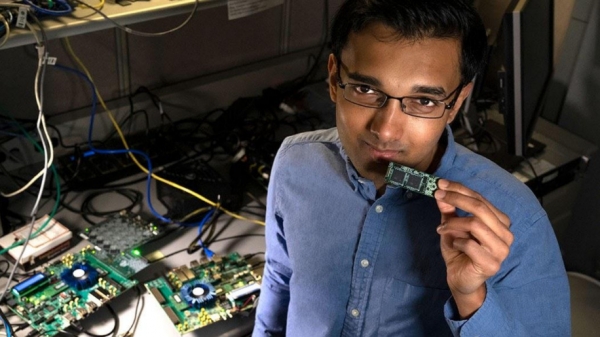

英特尔实验室和康奈尔大学的研究人员展示了英特尔神经形态研究芯片Loihi独特的能力:仅根据气味就能识别多种有害化学物质。

研究人员说,Loihi可以根据测试样品的气味识别出每种化学物质,而不会颠覆此前学习到的气味记忆。不仅如此,与任何传统的识别系统(包括深度学习系统)相比,Loihi芯片还显示出更高的准确性,而深度学习系统则需要大约3000倍的训练样本,才能达到相同的准确性。

英特尔实验室高级研究科学家Nabil Imam说:“我们正在基于Loihi开发神经算法,以模仿人类闻到气味后大脑的反应。这项工作是在神经科学和人工智能交叉领域进行当代研究的一个典范,证明了Loihi具有重要的传感潜力,可以让各行各业从中受益。”

Loihi芯片是一种旨在模仿人脑处理和解决问题方式的硬件。该芯片于2017年9月首次发布,当时英特尔称,Loihi具有“令人难以置信的”学习速度。Loihi芯片的独特之处在于,它可以利用已有知识来推断新数据,从而随着时间的推移,以指数速度加快学习过程。

Loihi芯片基于“神经形态计算”架构,该架构的灵感来自科学家对人脑及人脑解决问题的最新理解。

今天发表在《自然机器智能》杂志上的这项最新研究,描述了英特尔实验室和康奈尔大学研究团队如何基于人脑嗅觉回路的结构和动力学,从零开始开发神经算法。Loihi芯片可以学习并识别10种不同危险化学品的气味。

要了解Loihi是如何做到这一点的,将进一步有助于了解人脑如何感知不同气味。例如,当一个人拿起葡萄柚闻气味的时候,水果中的分子会刺激鼻子的嗅觉细胞,由嗅觉细胞发送给大脑。然后,在相互连接的神经元组中的电脉冲产生对该气味的独特感知。

英特尔研究人员解释说:“无论你闻的是葡萄柚、玫瑰还是有害的气体,大脑中的神经元网络都会产生该物体特定的感觉。类似地,你的视觉和听觉、记忆、情绪、决策都有各自的神经网络,以特定的方式进行计算。”

英特尔团队在最新研究中采用的数据集中,包含了大脑对72种已知化学物质的感官活动以及响应每种化学物质气味的方式。这些数据被用于配置英特尔研究团队开发Loihi芯片的“生物嗅觉电路图”。这样一来,Loihi芯片就可以识别每种气味的神经表示,并识别每种气味。

Moor Insights&Strategy分析师Patrick Moorhead表示,英特尔的这项研究表明,确定各种有害化学物质的气味,是神经形态计算的一个很好的用例。

Moorhead称:“神经运动计算就像人类大脑一样进行训练和推断,因此,很高兴看到英特尔在这一研究领域开辟了一条道路。”

Imam在博客文章中表示,可以将Loihi的嗅觉能力作为帮助医生诊断疾病的新型“电子鼻系统”,其他用途还包括开发更高效的烟雾和一氧化碳探测器,或者是在机场探测武器和爆炸物。

“下一步是将这种方法推广到解决更广泛的问题,从感官场景分析(理解你观察到的物体之间的关系)到抽象问题,例如计划和决策。了解大脑神经回路如何解决这些复杂的计算问题,将为设计高效而强大的机器智能提供重要的线索。”

来源:siliconANGLE

好文章,需要你的鼓励

SanDisk重塑经典SSD品牌:WD Black和Blue正式更名为Optimus系列

西部数据闪存业务分拆后,SanDisk宣布将停用广受欢迎的WD Black和Blue品牌,推出全新的SanDisk Optimus系列NVMe产品线。WD Blue驱动器将更名为SanDisk Optimus,而高端WD Black驱动器将分别更名为Optimus GX和GX Pro。尽管品牌变更,底层硬件和供应链保持不变。然而受全球内存短缺影响,预计2026年第一季度客户端SSD价格可能上涨超过40%。

上海AI实验室研究者想出妙招:让AI像优秀学生一样高效思考,告别“想太多“毛病

上海AI实验室开发RePro训练方法,通过将AI推理过程类比为优化问题,教会AI避免过度思考。该方法通过评估推理步骤的进步幅度和稳定性,显著提升了模型在数学、科学和编程任务上的表现,准确率提升5-6个百分点,同时大幅减少无效推理,为高效AI系统发展提供新思路。

福特汽车准备在车载系统中引入AI智能助手

福特汽车在2026年消费电子展上宣布将在车辆中引入AI助手技术。该AI助手最初将在福特和林肯智能手机应用中推出,从2027年开始成为新车型的原生功能。福特希望通过AI技术实现车辆个性化体验,提供基于位置、行为和车辆能力的智能服务。同时,福特将采用软件定义车辆架构,推出自研的高性能计算中心,提升信息娱乐、驾驶辅助等功能。

MIT团队让机器人终于不再“卡顿“:一种让机器人像人一样流畅反应的突破性技术

MIT团队开发的VLASH技术首次解决了机器人动作断续、反应迟缓的根本问题。通过"未来状态感知"让机器人边执行边思考,实现了最高2.03倍的速度提升和17.4倍的反应延迟改善,成功展示了机器人打乒乓球等高难度任务,为机器人在动态环境中的应用开辟了新可能性。

智能体驱动全球创新浪潮,微软携手前沿伙伴迈进消费电子新未来

达索系统在CES 2026上展示AI驱动的医疗创新, 重塑精准、可预测与个性化医疗

Arm 发布 20 项技术预测:洞见 2026 年及未来发

美光推出全球首款面向客户端计算的 PCIe 5.0 QLC SSD

SanDisk重塑经典SSD品牌:WD Black和Blue正式更名为Optimus系列

福特汽车准备在车载系统中引入AI智能助手

ChatGPT推出健康模式:结合医疗数据提供个性化建议

福特推出AI数字助理及新一代BlueCruise自动驾驶技术

联想Legion Pro可卷曲概念机展现移动大屏游戏新体验

印度和新加坡在智能体AI采用方面超越全球同行

华硕CES 2026新品:更小巧的ProArt GoPro笔记本和升级版Zenbook Duo

n8n警告CVSS满分漏洞影响自托管和云版本